AIが揺さぶる安全保障の基盤

AIガバナンスを巡る論点2025 ⑨

大澤 淳

中曽根康弘世界平和研究所 上席研究員

AI(人工知能)が驚くべきスピードで進化している。人間の知をはるかに超えるAGI(汎用人工知能)、ASI(人工超知能)の実現も近いという見方もある。AIは、人間にとって便利な道具であり続けるのか、はたまた、人間を支配する脅威となるのか――。デジタル政策フォーラムのメンバーおよび関係者にその問題意識を聞くシリーズ第9回は、大澤 淳 中曽根康弘世界平和研究所 上席研究員に安全保障とAIの関係について聞いた。(聞き手は、谷脇康彦 デジタル政策フォーラム 代表幹事、以下敬称略)

大澤 淳 中曽根康弘世界平和研究所 上席研究員

大澤 淳 中曽根康弘世界平和研究所 上席研究員

社会の集合知としてのAIを守れ

谷脇 AIが社会、文化、産業、経済に与えるインパクトについては多くが語られていますが、いよいよ安全保障の中核にも入り込みつつあるという問題意識を持っています。安全保障の専門家としてどのように見ていますか。

大澤 AIの発達による安全保障面への影響は、情報戦・認知戦、サイバー攻撃、兵器運用の三つの領域で既に顕在化しています。

個別の話に入る前に、AIによって人々の認識がどのように変わっているのかという大前提を押さえておく必要があります。それは、人々が知識を獲得する方法が大きく変わってきたということです。

インターネット以前、知識の源泉は百科事典や専門書であり、図書館が社会の集合知が結集する場でした。何か知りたいことがあれば、図書館に行って本を選び、紙に書かれた知識を引き出すというやり方です。

インターネットの時代に入ると、検索によって知識を引き出すようになり、Wikipediaのようなデジタルの百科事典も急速に整備されていきました。社会の集合知は図書館からデジタル空間への移行が進んだのです。

そして今、AIの登場によって次の段階に入ろうとしています。人々は検索ではなく、AIに聞き、AIから直接答えを得るようになっています。検索では関連する情報の一覧を得られますが、AIは答えそのものを返してきます。AIが返す答えがそのまま「正しい知識」だと受け入れられることも少なくないでしょうし、その傾向はますます高まっていくでしょう。つまり、AIが内部に持っているデータや学習結果が、社会の集合知として機能し始めているのです。

そうなってくると、ちょっと困ったことが起きてきます。AI の学習データを意図的に間違った学習(情報汚染、コンタミネーション)をさせれば、社会の集合知そのものを書き換えることが可能になってしまうのです。これは従来の情報操作とは質的に異なるものです。

例えば日中間の歴史認識については、学術的な議論を積み重ね一定の理解が形成されてきました。異なる主張があっても、論文や史料、専門家の議論を通じて検証され、少なくとも何が争点かということは共有されてきました。中国は日中戦争時に南京で30万人が虐殺されたと主張しますが、日本は当時の南京の人口は数万人程度なのでそのような大虐殺はあり得ないと反論していているというのは一例です。検索すれば、両方の主張が返ってきます。

ところが、AI時代は、AIが学習した内容が正しい答えとして返ってきます。中国政府の主張をニュースサイトやそれらしく見える情報源から大量に学習させれば、AIに「南京大虐殺とは何か?」と聞いたとき、「30万人が虐殺された」という中国政府の主張があたかも事実であるかのように返してくる。既に、そういう工作が情報戦の一環として行われ始めています。単なる情報操作の域を超えた、集合知を標的とした認知戦です。

もっと卑近なマーケティング領域にも影響は及びます。飲食店の集客では食べログのようなレビューサイトで上位に掲載されるためにユーザー評価の星を増やすことが優先課題でしたが、これからはAIの回答の中に入れるか、AIの回答の上位に食い込めるかが勝負になります。人々の消費行動がAIによって左右されてしまうのです。

AIを騙すために誤ったあるいは偏ったデータを学習させるという悪意のある行為から我々が使うAIを守ることが、安全保障上、社会生活上の新たな課題として浮上しています。

AI活用で激しさを増す情報戦・認知戦

谷脇 同様の懸念を「アルゴリズム化されたネットワーク」というコラムに書きました。これまでは人と人がネットワークを介してつながる構造でしたが、人と人の間にAIが入ってきたり、AIとAIが直接つながって会話したりするようになっています。人と人のコミュニケーションの場合、議論を重ねることによって妥協や新たな気づきに至り、より多くの人々が合意できる中間解(コンセンサス)を形成することができました。しかし、妥協や曖昧さを許さないAIが入ってくると、主張がどんどん先鋭化して落としどころが見つけられないという状態に陥るのではないかと懸念しています。安全保障の観点からは抑止戦略が効かなくなって暴発の恐れさえあるのではないでしょうか。

大澤 今のところ、AI の軍事利用は自動火器管制や意思決定支援など部分的にところにとどまり、戦略的判断は依然として人間が担っています。AIの暴走によって抑止効果が崩壊するようなことはないとは思います。

ただし、戦場の最前線では無人兵器の増加によって状況が変わりつつあります。ラストワンマイルでの攻撃判断をAIが担う場面が増え、国際法上、倫理上の問題が現実の課題として浮上してきています。そして、先ほども述べたように、より深刻なのは「情報空間」での戦いがあからさまに激しさを増していることです。昨今の日中関係の悪化を見ても、中国国内の対日感情、日本国内の対中感情がAIによって増幅され誘導されようとしており、危うさを感じています。

谷脇 日本としても、認知戦、情報戦への備えを本気で考えるべき段階に来ていますね。

大澤 おっしゃる通りです。AIがからむことで、これまでにもあった情報操作の手法が大きく変わってきています。

この十年、ロシアを起源として、情報戦、認知戦、影響工作と呼ばれる手法が欧米の情報空間で顕在化してきました。ヨーロッパではFIMI(Foreign Information Manipulation and Interference)という概念で整理されています。

初期は、トロール部隊と呼ばれる単純な方法でした。英語ができるロシア人を低賃金で雇って24時間3交代でSNSに大量投稿を行ない、アメリカの情報空間をロシア寄りに誘導するというものです。しかしこれはアメリカの情報機関による特定・摘発が進んで廃れました。

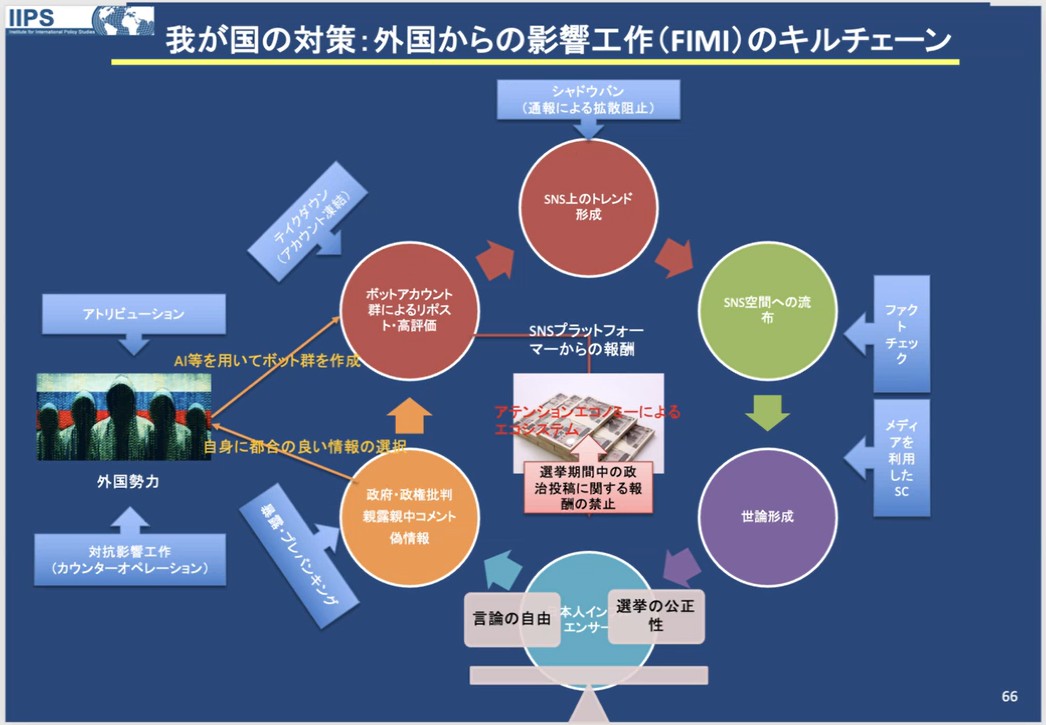

今の主流は、相手国民の発言を影響工作に活用する手法です。アメリカ国内のインフルエンサーの中から、親ロシア的、あるいは自国政府に批判的な言説を発信する人物を選び、その投稿を生成AIのBot群で増幅するというやり方です。直接お金を渡して工作をしているわけではありません。インフルエンサーの発言がBotによって拡散され、トレンドに乗ることで、アテンションエコノミーの仕組みの中で結果的に収益が発生する、間接的に報酬が支払われる構造です。ロシア発の書き込みなら規約違反で止められますが、アメリカ人によるアメリカ国内からの発信なので、表現の自由の壁があって規制が難しい。

この新しい手法への対抗策としてアメリカ政府が狙いをつけたのは、インフルエンサー本人ではなく、増幅に使われているBotアカウント群です。これを司法省からXなどのプラットフォームに対して、自動生成・自動増幅の証拠と共に通知し、規約違反としてアカウント凍結を要請するのです。

例えば2025年7月に司法省は約1000アカウントを一斉凍結させたのですが、同一IPアドレス、同一ドメインから大量に作られたアカウントや異常な速度でリポストを繰り返すアカウントなどを、データ分析で洗い出しました。これは人手では不可能で、AI活用を前提としたビッグデータ分析の勝負になっています。そうした能力がなければ、情報戦の攻撃に対する防御が追い付かなくなっているのです。

影響工作の連鎖を断ち切る方策が必要

谷脇 同じことを日本でやろうとすると、かなり反発が出そうな気がします。

大澤 そうかもしれません。ただ、X、YouTube、TikTokなどは公開の掲示板であり、私信ではないので投稿情報を収集・分析すること自体は禁じられていません。実際、Xの規約では、人為的な増幅を目的としたアカウント、市民社会の意見形成を意図的に歪めようとするアカウントは凍結対象になっています。凍結されたアカウントが訴訟を起こすケースはほとんどありません。やっている側は悪意を自覚していますから。

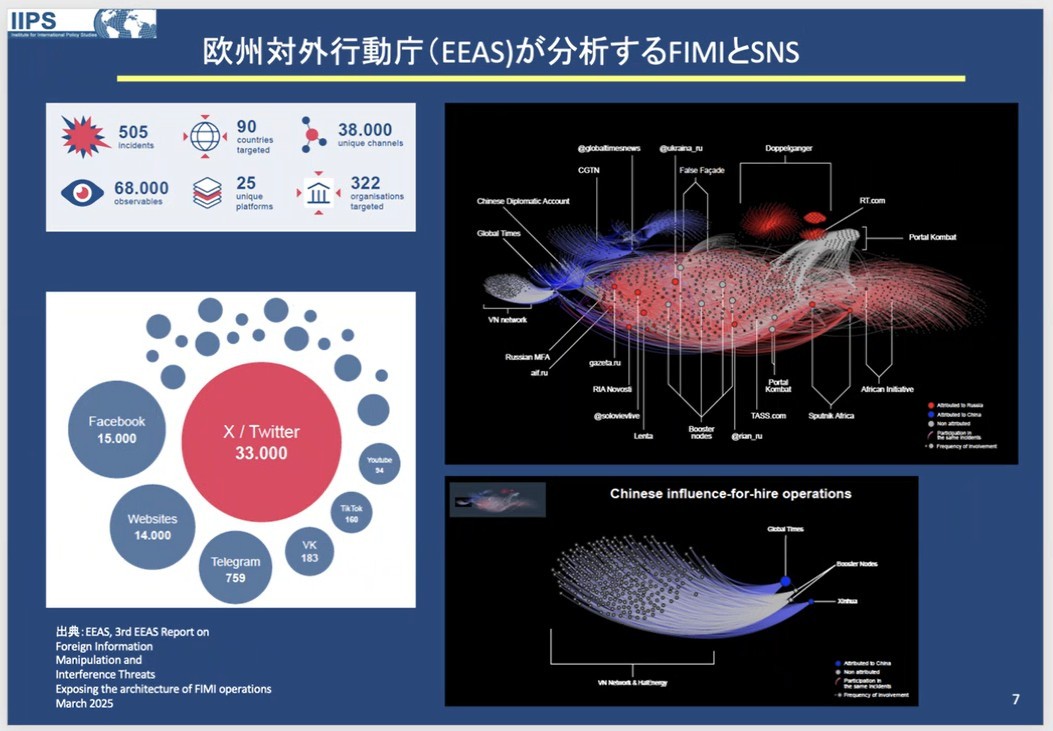

ちなみに、これは欧州対外行動局(European External Action Service: EEAS)が中国・ロシアによる情報戦を分析した年次レポート(3rd EEAS Report on Foreign Information Manipulation and Interference Threats、2025年3月)からの抜粋です。2024年における90カ国にわたる505件の事案を分析すると、FIMIに悪用されているSNSプラットフォームとしてはXが圧倒的に多い。それにFacebook、ウェブサイト、テレグラム、TikTok、YouTubeが続きます。

右側上段にグラフ理論による分析図があって、赤がロシア系、青が中国系の影響工作で、中国系が増加中です。その図の左側の部分を拡大したものを下に貼り付けてありますが、公的な中国メディアであるGlobal Timesが発信した情報をBot群がブーストしているという分析がなされています。これは従来ロシアがやってきた手法ですが、中国もそれを真似てやり始めているようです。プラットフォーマー側に規制を強化してもらう必要があると思っています。

谷脇 2025年の参議院議員選挙の際にも、Botによる偽情報、誤情報の拡散が指摘されました。日本でも認知戦対策は重要な研究課題ですね。

大澤 はい。特に選挙は深刻です。

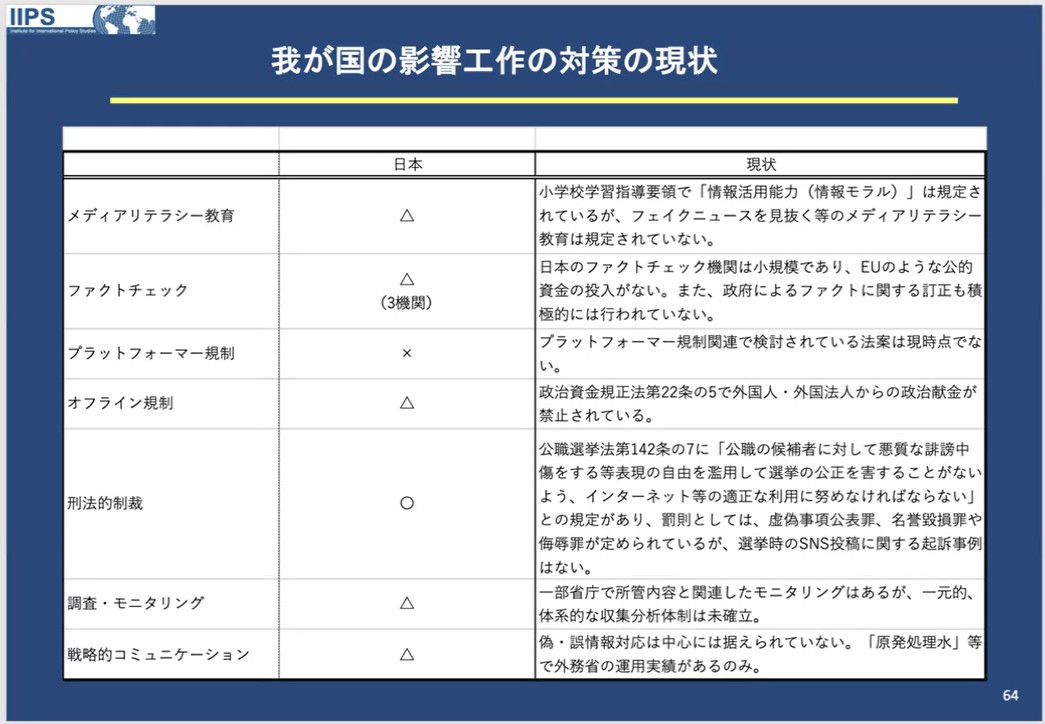

AIに限らないのですが、影響工作には多層的な対策が必要になっています。メディアリテラシー教育、ファクトチェックに加えて、プラットフォーマー規制、オフライン規制、刑法的制裁を組み合わせて対策していく必要があると思います。

ただし、インフルエンサーの発言から政府批判や親ロ・親中のコメントを選択的に抽出して、それをAIを使ったBot群で増幅し、トレンドを作り、結果的にアテンションエコノミーでインフルエンサーに報酬が渡るという仕組みなので、その循環をどこかで断ち切らなければなりません。

現実的な対策として考えられるのは、選挙期間中に限って、特定候補や政治テーマに関する投稿への報酬支払いを制限するといった措置があります。1年365日常に規制するのは難しいとしても、選挙期間という「民主主義の基盤として最も重要な期間」に限定すれば、一定の合理性はあると思います。

谷脇 同感です。ただ、選挙期間前はどうするのか、という問題は残りますね。

大澤 そこはまさに言論の自由と選挙の公正性、社会の安定性との比較衡量になります。だからこそ恒常的な規制ではなく、時限的・限定的なルール設計が現実解だと思います。あるいは、プラットフォーマー側にインフルエンサーに支払う報酬について源泉徴収を義務付ければ抑止効果があるでしょう。法改正が必要ではありますが・・・。また、日本政府のデータベースが税務署、出入国管理局、情報当局とですべて切り離されているので突合して分析することができないという問題もあります。

谷脇 それはできないですね(苦笑)。特にAIとの関連で他に注意すべき論点はありますか。

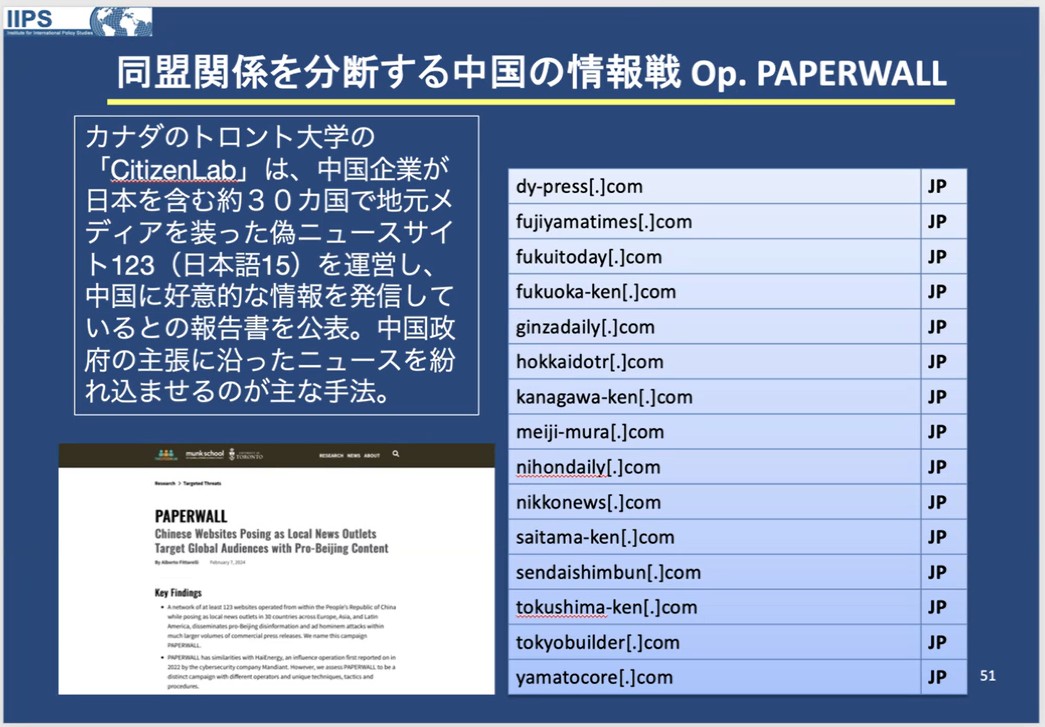

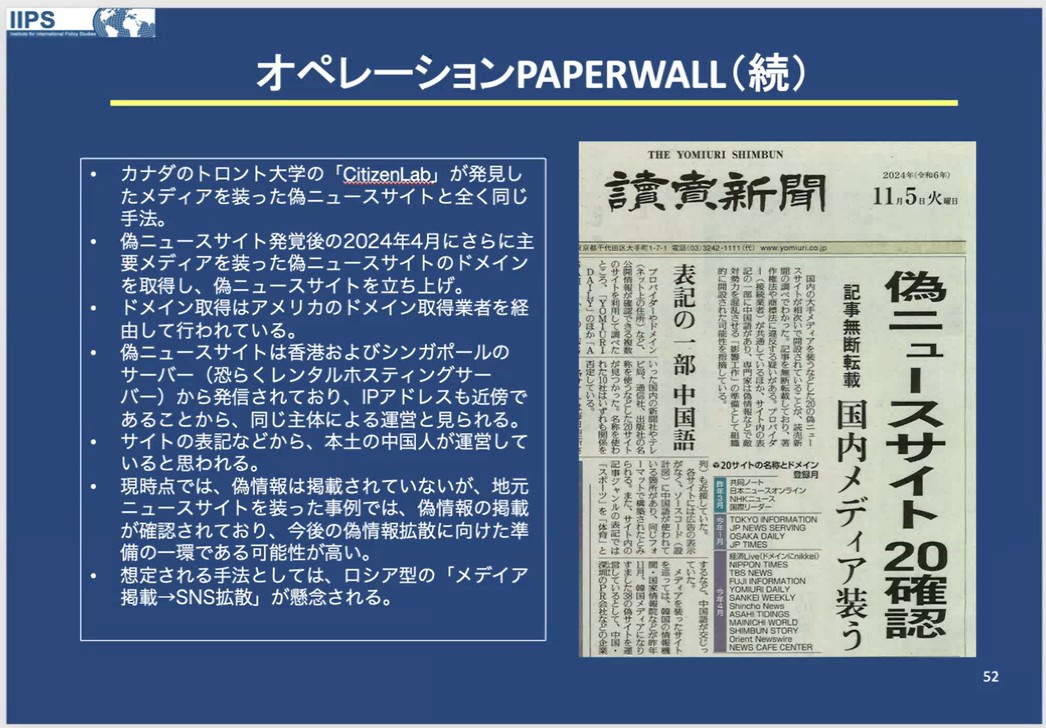

大澤 危惧しているのは偽ニュースサイト問題です。一見すると地方紙やニュースサイトのようですが、よく見ると違和感だらけの異様な日本語記事が大量に掲載されているのです。そこに5%ぐらいの割合で中国寄りの記事が紛れ込んでいます。

これを説明できる唯一の仮説は、AIに学習させるためのデータを集めて掲載しているということです。既存のクオリティペーパーの多く、アメリカならニューヨークタイムズやワシントンポスト、日本では日経、読売、朝日などは多くの記事を有料にしていてペイウォールを超えないと閲読できないようにしているのでAIが勝手に学習することができません。そこで、AIに学習させるためだけのサイトをわざわざ作っていると考えられるのです。このような偽ニュースサイトについては、2024年に、トロント大学の研究機関がリポートを公表したり、読売新聞が報道したりしています。

例えばFujiyama Times、Fukuoka-ken.com、共同ノート、NHKニュースといったドメイン名や名称を使い、あたかも正規のニュースサイトであるように見せていますが、全くの偽物です。ですが、AIがネット上のコンテンツを学習する際には真贋の区別がつかないので、日本語ニュースサイトに掲載されたデータとして読み込んでしまいます。同じような偽ニュースサイトを多数つくり、そこに偽ニュースを流せばAIの学習データを汚染できてしまうのです。その結果、AIに政治や歴史について尋ねると、歪められた答えが出典メディア付きで返されるという仕組みです。

トロント大学のCitizenLabの報告によれば、中国によって世界30カ国、123以上のサイトをネットワークした偽情報ネットワークが構築されていて、日本は韓国に次いで主要なターゲットになっています。各国の認知空間を長期的にコントロールする高度な情報戦・認知戦であり、CitizenLabはこれを「Paperwall作戦」と名付けています。

ソブリンAIの議論、経済合理性よりも安全保障優先で

谷脇 ここまでのお話を踏まえると、やはりソブリンAIやソブリンクラウドといった議論を避けて通れないと感じます。中国は2023年に国家データ局を設置し、データの活用やデータスペースの構築を含めて、非常に戦略的に動いています。日本はそこまで俯瞰的な戦略を描けていないように見えます。

大澤 中国は、AIをめぐる戦略をかなり明確に持っています。国内向けには、生成AIの出力やデータに透かしを入れることを義務づけるなど、自国の認知領域を守る法制度を次々に整備している。一方で、国際的には「自由にやらせろ」という立場を取る。中国の認知戦の戦略文書を見ると、「自分たちの認知領域を守り、相手の認知領域を攻撃する」という発想が明確に書かれています。

そう考えると、日本語の偽ニュースサイトや学習データの汚染といった動きも、近視眼的、偶発的なものではなく、長期的な戦略的行動として理解できます。

谷脇 中国は国際標準の主導権争いでも非常に積極的ですね。かつて、ITU(国際電気通信連合)やISO(国際標準化機構)などの会合に出席しているのは中国企業ばかりで、中国語で議論をしているような状況がありました。AIについても、国産の中華AIを守りつつ、国外では自由という名を掲げて中国主権を握ろうとしている意図がありありです。その姿勢は一貫しています。

大澤 そうですね。今、中国はデジタル透かしの国際標準を取ろうとしています。そうすれば中国で生成したAI情報は真正情報としてコントロールでき、逆に欧米から中国に入ってくる情報は規制できるようにすることを見据えた戦略行動だと思います。デジタル透かしの標準化を進めているW3C(ワールドワイドウェブコンソーシアム)の主導権はほぼ中国に握られている状況です。

中国の「中国製造2025」という計画は有名ですが、これとは別に「中国標準2035」という計画もあります。中国が世界の大国として君臨するために国際標準を重要ターゲットとして位置付けているのです。日本としては、国際ルール作りの場で知らないうちに中国に有利なルールができてしまうことがないように強く警戒しなければなりません。

そして、ソブリンAI、ソブリンクラウドは、日本の安全保障のために必要だと思います。日本人の集合知を適正に維持するという観点からも、国産AI、国産データベースを確保し、それを日本人が使うようにしないと、日本の情報空間はどんどん歪められていってしまうでしょう。その兆候は既にあります。大きなリスクだと感じています。

谷脇 デジタル主権、デジタル空間でのソブリンティについて十分意識した政策が必要ですね。

大澤 動画を生成するとか、創作活動に活用するというような一般的な利用はともかく、日本という国の行く末を考えたり判断したりするための知識を得たり、ニュースを読んだり、あるいは政治情報を発信したりするといった用途に使われるAIは、国産のものを使う必要があると思います。欧米製のAIの場合は、何らかのルールに基づいて学習データを適正にコントロールすべきです。

また、政府や国民のデータを預けるのは、日本国内で日本企業が構築・管理するソブリンクラウドで、セキュリティクリアランスを持った日本人が運営するということが最低限必要だと思います。経済合理性よりも国家安全保障を優先すべき問題です。

谷脇 サイバーセキュリティの領域では、AIを活用してエクスプロイト(ソフト・ハードの脆弱性を狙った攻撃)が自動化されています。攻めも守りもAIエージェントの戦いということになれば、エスカレーションが止まらなくなってしまうのではと危惧しています。

大澤 100パーセント共感します。システムにおける脆弱性の公表から、そこを目がけてサイバー攻撃が始まるまでのタイムラグが短くなり、今や24時間を切っています。以前は大企業など金になりそうな標的を選別した「点の攻撃」が主流でしたが、最近は脆弱性があるところを片っ端から侵入してみる「面の攻撃」へと移行しています。守る側も「面の防御」が必要になり、対策コストがどんどん上がります。

このまま進めば、ネットワークを使うための総コストが上がり、DX(デジタルトランスフォーメーション)が遅滞することにもなりかねません。インターネットは危ない、ファクスで受発注した方が安全だし安上がりだというような先祖返りにつながるかもしれません。笑い話ではありません。これまでに築いてきたインターネットの信頼性がAIの登場で加速度的に崩れてしまう可能性があるのです。

「デジタルのベルリンの壁」に対するため横断的国家戦略を

谷脇 AIと安全保障の文脈で、国際的な合意やルール形成によって歯止めをかけることは難しいのでしょうか。2024年には欧州評議会がAI関連で初となる国際条約(人工知能と人権、民主主義及び法の支配に関する欧州評議会枠組条約の署名)を採択し、日本も署名しました。また、サイバー空間における国家間の攻撃・防御について国際法の適用や基準について明文化したサイバー戦争のルールブックとも言える「タリン・マニュアル」もアップデートが重ねられています。しかし、いずれも万能ではないように感じます。

大澤 なかなか難しいですね。中国・ロシア、グローバルサウス、西側先進国それぞれの考え方がバラバラなので、包括的な合意は期待しにくい状況です。結果として、通信や情報空間はブロック化され、インターネットのフラグメンテーションが進みつつあります。中国やロシアは既に国内だけでネットワークを維持できるシステムを整えつつあり、実験も行っています。

谷脇 「デジタルのベルリンの壁」という表現が現実味を帯びてきますね。

大澤 はい、既に言論空間は事実上分断されています。中国はグレートファイアウォール(金盾)を介して国外から入ってくる情報をコントロールし、中国語の空間に西側の論調が入り込んでこないようにしています。ロシアも最近、欧米プラットフォーマーのSNSを国内で利用することを禁じたりしています。これは、ウクライナ戦争の影響が大きいようです。

こうした状況だからこそ、最低限、ソブリンAIやソブリンクラウドが必要なのです。メディア(報道)、広告・マーケティング、著作権の既存モデルは早晩成り立たなくなるでしょうから、価値と対価がきちんと循環するエコシステムの再設計も必要です。

谷脇 全体を俯瞰して国家戦略として考える必要がありますが、日本政府は縦割りが過ぎて横串を通すのが苦手です。

大澤 そうですね(笑)。AI時代の安全保障、AI時代のサイバーセキュリティ、AI時代の経済安保といった横断テーマは、単一の省庁だけで扱える代物ではありません。個人的には、縦割りの組織に横糸を通すのは、「人のネットワーク」しかないと思っています。泥臭いのですが、忘年会や新年かで一緒に飲むとか、同期入省・入社のネットワークを大切にするとか・・・。そうした横軸のコミュニティをいかに形成するかは、日本の組織における古くて新しい課題です。意識的に紡いでいかなければいけません。

谷脇 とても大切なことだと思います。大澤さんが所属されている笹川平和財団や、手前味噌ながら私が取り組んでいるデジタル政策フォーラムといったオープンな場でのコラボレーションが広がっていくと、分野横断的な議論に厚みを加えることができるかもしれません。

大澤 そうしたコミュニティの中で政治家、官僚、学者、経済人、企業人の横のつながりを形成していきたいですね。それはAIにはできないことですから。

谷脇 たいへん奥深いお話をいただき、ありがとうございました。

大澤 淳 / Jun Osawa

公益財団法人 中曽根康弘世界平和研究所 上席研究員

1971年生。慶應義塾大学法学部1994年卒、同大学大学院法学研究科修士課程1996年修了(法学修士)。1995年世界平和研究所研究員、2009年同主任研究員、2014年〜2016年内閣官房国家安全保障局参事官補佐(サイバー安全保障担当)、2017年〜2025年中曽根康弘世界平和研究所主任研究員、2025年より同研究所上席研究員。現在、鹿島平和研究所理事、独立行政法人情報処理推進機構(IPA)サイバー情勢研究部部長、笹川平和財団上席フェロー、電通総研経済安全保障センター研究主幹を併任。2004年〜2006年外務省国際情報統括官組織専門分析員、2007年〜2009年外務省総合外交政策局外交政策調査員、2013年米国ブルッキングス研究所客員研究員、2012年〜2016年政策研究大学院大学(GRIPS)客員研究員、2017年〜2019年内閣官房国家安全保障局シニアフェローを併任している。専門は国際政治学(戦略評価、サイバー安全保障)。

最近の著作に、『ウクライナ戦争はなぜ終わらないのか』(共著、文春新書、2023年)、『新領域安全保障』(共著、Wedge、2024年)、『SNS時代の戦略兵器 陰謀論』(共著、Wedge、2025年)。